Ollama AI-dan foydalanib, Raspberry Pi-da LLM-larni mahalliy ravishda ishga tushiring haqida malumot

O’tgan hafta men o’quv qo’llanmasini baham ko’rdim PrivateGPT yordamida. Bu hujjatlar bilan ishlash uchun AI vositasi.

Endi, bu cheklangan foydalanish uchun yaxshi, lekin agar siz hujjat bilan ishlashdan ko’ra ko’proq narsani xohlasangiz, boshqa loyihalarni o’rganishingiz kerak.

O’shanda men qiziqarli loyihaga duch keldim Ollama. Bu ochiq kodli loyiha bo’lib, u sizga turli xil yirik til modellarini (LLM) mahalliy darajada ishlatish imkonini beradi.

Reddit hamjamiyatlarini ko’rib chiqayotib, men Raspberry Pi-da LLMlarni ishga tushirish haqida gapiradigan munozaralarga duch keldim.

Men ushbu «da’vo» ni tekshirishga qiziqdim, shuning uchun men Raspberry Pi 4-da Ollama bilan mahalliy LLMlarni ishga tushirishga qaror qildim.

Ushbu qisqa maqolada tajribalarimni siz bilan baham ko’rishga ijozat bering.

📋Ushbu maqolada siz AI, LLM va boshqa tegishli vositalar va jargonlar haqida asosiy tushunchaga ega ekanligingizni nazarda tutadi.

Ollama-ni Raspberry Pi OS (va boshqa Linux) da o’rnatish

Ollamani o’rnatish jarayoni oson. Linux-ga o’rnatish uchun siz ularning rasmiy o’rnatish skriptini olib, uni ishga tushirishingiz kerak. Bu ularning veb-saytida tasvirlangan rasmiy usul.

Siz uni qo’lda yuklab olishingiz va nima qilishini o’qishingiz mumkin. Yoki, agar siz men kabi dangasa bo’lsangiz, ikkalasini bitta buyruqda birlashtiring:

curl https://ollama.ai/install.sh | sh

Turli LLMlarni o’rganish

O’rnatish tugallangach, siz Pi-da LLM-larni ishga tushirishga va qisqa vaqt ichida AI bilan suhbatlashishga tayyormiz.

Tajribamda men foydalanardim tinyllama , phi va llava LLMlar. Ammo siz mavjud bo’lgan turli xil katta til modellarini sinab ko’rishingiz mumkin Ollama kutubxonasi.

📋8B modellarini ishga tushirish uchun sizda kamida 7 GB operativ xotira, 16B modellarini ishga tushirish uchun 13 GB va 32B modellarini ishga tushirish uchun 33 GB bo‘lishi kerak.

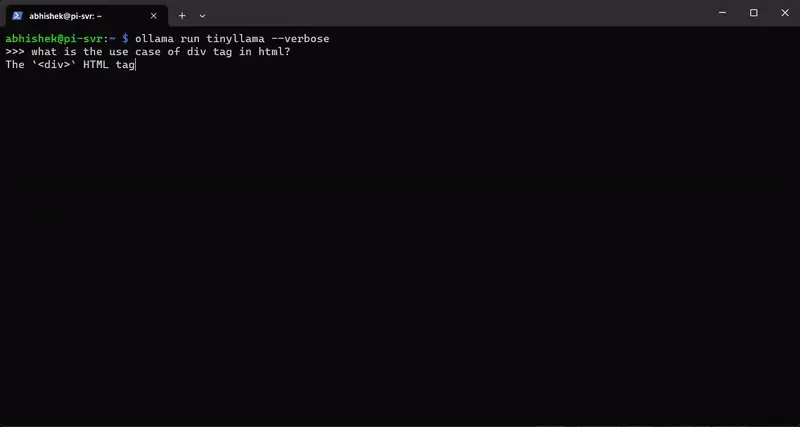

TinyLlama

Keling, boshlang TinyLlama 1.1 milliard parametrga asoslangan va birinchi urinish uchun mukammal nomzod.

TinyLlama-ni yuklab olish va ishga tushirish uchun siz ushbu buyruqni kiritishingiz kerak:

ollama run tinyllama

Til modelini yuklab olish uchun bir necha soniya kerak bo’ladi va u yuklab olingandan so’ng siz u bilan suhbatni boshlashingiz mumkin.

Men sun’iy intellektga qo’yadigan savolim: «html-da div tegidan foydalanish holati qanday?»

Buni tugatish vaqti bilan to’liq javob:

Xo’sh, yaxshi, yaxshi! AI Raspberry Pi-da bu qadar tez ishlashini kim taxmin qilgan edi?

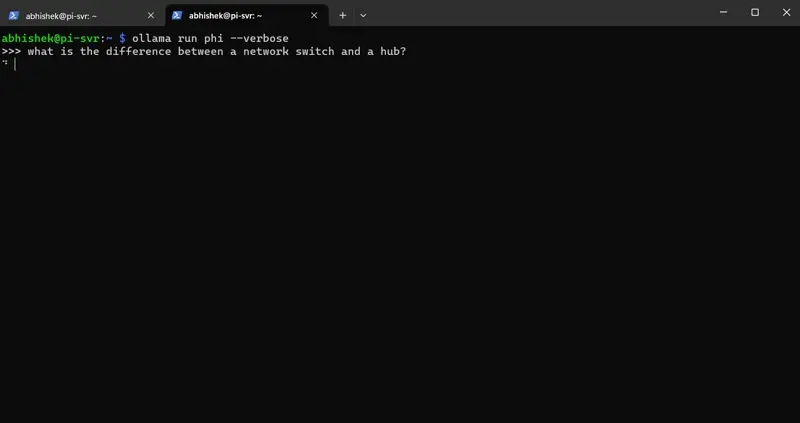

phi

Kattaroq modellarga o’tish kabi phi bu 2.7B parametrlarga asoslangan til modeli. O’ylaymanki, bizning Raspberry Pi ham buni hal qila oladi.

Ushbu modelni o’rnatish va ishga tushirish uchun quyidagi buyruqni kiriting:

ollama run phi

Unga men kabi savollar berib koʻring: “Tarmoq kommutatori va hub oʻrtasidagi farq nima?”

va boshqa tafsilotlar bilan phi dan to’liq javob:

llava

Bu men sinovdan o’tkazadigan eng katta LLM, chunki u 7B parametrlari bilan birga keladi. Men undan oddiy savollarni berish o’rniga tasvirni tasvirlashni so’rayman.

Men Raspberry Pi 4 ning 4 GB modelidan foydalanmoqdaman va u yuqoridagi boshqa til modellari kabi ishlaydi deb o’ylamayman.

Biroq, keling, buni sinab ko’raylik. O’rnatish uchun llava ushbu buyruqdan foydalaning:

ollama run llavaUshbu modelni yuklab olish uchun biroz vaqt kerak bo’ladi, chunki u juda katta, 3.9 GB ga yaqin.

Men ushbu modeldan saqlangan mushuk tasvirini tasvirlashni so’rayman /media/hdd/shared/test.jpg katalog.

Men jarayonni o’rtada tugatishga majbur bo’ldim, chunki javob berish juda uzoq vaqtni oldi (30 daqiqadan ko’proq).

Lekin siz ko’rishingiz mumkinki, javob juda aniq va agar sizda 5 GB operativ xotiraga ega so’nggi Raspberry Pi 8 bo’lsa, 7B parametrli til modellarini osongina ishga tushirishingiz mumkin.

Xulosa

Raspberry Pi 5 imkoniyatlarini Ollama bilan birlashtirish mahalliy miqyosda ochiq manbali LLMlarni ishga tushirishni istagan har bir kishi uchun kuchli poydevor yaratadi.

Siz ixcham kompyuterlar chegaralarini kengaytirishga intilayotgan dasturchi bo’lasizmi yoki tilni qayta ishlash sohasini o’rganishga ishtiyoqmand bo’lasizmi, bu o’rnatish juda ko’p imkoniyatlarni taqdim etadi.

Linux, Texnologiyalar

Ollama AI-dan foydalanib, Raspberry Pi-da LLM-larni mahalliy ravishda ishga tushiring